5 phút để hiểu hơn về Deep Learning (Phần 2)

Ở phần trước chúng ta đã biết về khái niệm của Deep Learning, Hierarchical Feature Learning, và tại sao lại không gọi Deep Learning là Artificial Neural Networks. Hôm nay chúng ta sẽ tìm hiểu các góc nhìn khác về Deep Learning. Trong bài viết sẽ xuất hiện một số từ ngữ và kiến thức đã được đề cập ở phần một, các bạn có thể xem lại.

Còn bây giờ, cùng bắt đầu thôi!

Deep Learning được xem như Scalable Learning Across Domains

Deep Learning thể hiện vượt trội tương tự nhau về mặt bản chất trên miền vấn đề (problem domains) ở đầu vào lẫn đầu ra. Có nghĩa là, chúng không phải là một vài đại lượng ở dạng bảng (tabular format) mà là hình ảnh của dữ liệu pixel, tài liệu của dữ liệu văn bản hoặc tệp dữ liệu âm thanh.

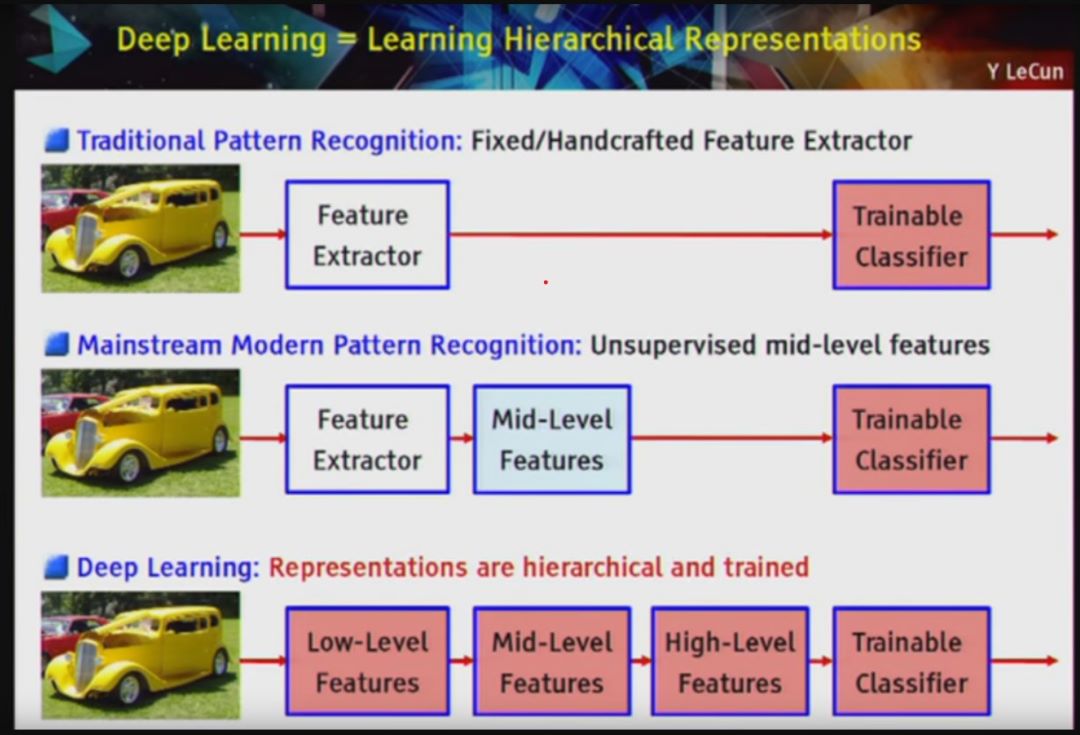

Yann LeCun là giám đốc của Facebook Research và là cha đẻ của kiến trúc mạng (network architecture) rất vượt trội về khả năng nhận dạng đối tượng trong dữ liệu hình ảnh được gọi là Mạng thần kinh tích chập (Convolutional Neural Network – CNN). Kỹ thuật này được nhận định như những thành công lớn vì giống như feedforward neural network theo perceptron nhiều layer, kỹ thuật này mở rộng quy mô dữ liệu và kích thước mô hình và có thể được đào tạo với backpropagation.

Điều này làm sai lệch định nghĩa của ông về Deep Learning rằng đây là sự phát triển của CNN rất lớn, vốn đã thành công vang đội về nhận dạng đối tượng trong ảnh.

Trong một bài nói chuyện năm 2016 tại Phòng thí nghiệm Quốc gia Lawrence Livermore với tiêu đề “Mở rộng hiểu biết: Học sâu, ứng dụng thông minh và GPU” (Deep Learning, Intelligent Applications, and GPUs), ông đã mô tả Deep Learning nói chung là learning hierarchical và định nghĩa nó như một cách tiếp cận có thể mở rộng để xây dựng hệ thống nhận dạng đối tượng (object recognition systems). Ông cho rằng Deep Learning là một hệ thống mô-đun tất cả đều có thể đào tạo được.. Sử dụng từ Deep là bởi vì có nhiều giai đoạn trong quá trình nhận biết một đối tượng và tất cả các giai đoạn đó đều là một phần của quá trình đào tạo.

Jurgen Schmidhuber là cha đẻ của một thuật toán nổi tiếng khác như MLP và CNN mà chúng cũng mở rộng quy mô với kích thước mô hình và kích thước tập dữ liệu và có thể được đào tạo với backpropagation, nhưng thay vào đó được điều chỉnh cho phù hợp với learning sequence data, được gọi là Mạng bộ nhớ ngắn hạn dài (Long Short-Term Memory Network – LSTM), một loại mạng nơ-ron tuần hoàn (recurrent neural network).

Tuy nhiên từ “Deep Learning” có thể bị nhầm lẫn trong diễn đạt của ông. Trong bài báo năm 2014 có tiêu đề “Học sâu trong mạng thần kinh: Tổng quan” (Deep Learning in Neural Networks: An Overview), ông bình luận về cách đặt tên có vấn đề của lĩnh vực này và sự khác biệt giữa Deep Learning và Shallow Learning. Ông cũng mô tả một cách thú vị sự sâu (depth) về mức độ phức tạp của vấn đề hơn là mô hình được sử dụng chỉ để giải quyết vấn đề.

“Shallow Learning kết thúc vấn đề ở mức nào và Deep Learning bắt đầu ở mức nào tiếp theo? Các cuộc thảo luận với các chuyên gia DL vẫn chưa đưa ra câu trả lời chính xác cho câu hỏi này. […], Hãy để tôi chỉ định nghĩa cho mục đích của cách nhìn tổng quan này: các vấn đề có độ sâu lớn hơn 10 thì yêu cầu Deep Learning rất cao.”

Demis Hassabis là người sáng lập DeepMind, sau này được Google mua lại. DeepMind đã tạo ra bước đột phá khi kết hợp các kỹ thuật Deep Learning với học tăng cường (Reinforcement Learning) để xử lý các vấn đề học phức tạp như chơi trò chơi, đã được chứng minh nổi tiếng khi chơi trò chơi Atari và trò chơi Go bằng Alpha Go.

Để phù hợp với cách đặt tên, họ đã gọi kỹ thuật mới của mình là Deep Q-Network – kết hợp Deep Learning với Q-Learning. Họ cũng đặt tên cho lĩnh vực nghiên cứu rộng hơn là “Học tăng cường sâu” (Deep Reinforcement Learning).

In keeping with the naming, they called their new technique a Deep Q-Network, combining Deep Learning with Q-Learning. They also name the broader field of study “Deep Reinforcement Learning”.

Trong tạp chí Nature năm 2015 của họ có tiêu đề “Kiểm soát cấp độ con người thông qua học tăng cường sâu” (Human-level control through deep reinforcement learning), họ nhận xét về vai trò quan trọng của deep neural networks trong bước đột phá của họ và nhấn mạnh nhu cầu trừu tượng phân cấp (hierarchical abstraction).

Để đạt được điều này, họ đã phát triển một tác nhân mới (novel agent), deep Q-network (DQN), có thể kết hợp reinforcement learning với artificial neural networks được gọi là mạng nơ-ron sâu (deep neural networks). Đáng chú ý là những tiến bộ gần đây trong deep neural networks, trong đó một số layer của node được sử dụng để xây dựng các biểu diễn dữ liệu dần trừu tượng hơn (abstract representations of the data), đã giúp artificial neural networks có thể học các khái niệm như danh mục đối tượng trực tiếp từ dữ liệu giác quan thô (raw sensory data).

Cuối cùng, trong những gì có thể được coi là một bài báo định định nghĩa khái niệm trong lĩnh vực này, Yann LeCun, Yoshua Bengio và Geoffrey Hinton đã xuất bản một bài báo trên tạp chí Nature với tiêu đề đơn giản là “Deep Learning”. Trong đó, họ đưa một định nghĩa rõ ràng về Deep Learning được làm nổi bật cách tiếp cận nhiều layer.

Deep Learning cho phép các mô hình tính toán bao gồm nhiều lớp xử lý (processing layer) để học cách biểu diễn dữ liệu với nhiều mức độ trừu tượng (levels of abstraction).

Sau đó, multi-layered approach này được mô tả dưới dạng học biểu diễn (representation learning) và trừu tượng (abstraction).

“Phương pháp Deep Learning là phương pháp representation learning với nhiều cấp độ biểu diễn, thu được bằng cách tạo ra các mô-đun đơn giản phi tuyến tính nonlinear modules) mà mỗi mô-đun chuyển đổi biểu diễn ở một cấp độ (với đầu vào thô) thành biểu diễn ở cấp độ cao hơn, trừu tượng hơn một chút . […] Khía cạnh quan trọng của Deep Learning là các layer tính năng này không được thiết kế bởi các kỹ sư con người: chúng được học từ dữ liệu bằng cách sử dụng quy trình học có mục đích chung.”

Đây là một mô tả hay và tổng quát, có thể dễ dàng mô tả hầu hết các thuật toán artificial neural network.

Tổng kết

Trong bài này, bạn đã tiếp cận nhiều định nghĩa, cách nhìn của các nhà khoa học, tuy nhiên có thể rút ra được rằng Deep Learning tóm gọn lại là các neural networks lớn trên nhiều dữ liệu hơn, đòi hỏi máy tính lớn hơn.

Mặc dù các phương pháp tiếp cận ban đầu được công bố bởi Hinton và các cộng tác viên tập trung vào đào tạo theo greedy layer và các phương pháp không được giám sát (unsupervised methods) như tự động mã hóa (autoencoders), học sâu tiên tiến hiện đại tập trung (modern state-of-the-art deep learning) vào đào tạo deep (many layered) neural network models bằng cách sử dụng thuật toán backpropagation. Các kỹ thuật phổ biến nhất là:

- Mạng Perceptron nhiều lớp (Multilayer Perceptron Networks)

- Mạng Nơ-ron hợp pháp (Convolutional Neural Networks)

- Mạng thần kinh tái tạo bộ nhớ ngắn hạn dài hạn (Long Short-Term Memory Recurrent Neural Networks)

Hy vọng bài này giúp bạn sáng tỏ Deep Learning là gì và cách các định nghĩa hàng đầu của các chuyên gia phù hợp với nhau dưới một góc độ nào đó.

Rồi sao nữa….

Rõ ràng Deep Learning không thể thực hiện trên một chiếc máy tính cấu hình không đủ mạnh được. Như vậy phải làm sao?

iRender là công ty công nghệ điện toán đám mây (Cloud computing) của Việt Nam cung cấp các dịch vụ phục vụ cho Deep Learning/AI trên nền tảng điện toán đám mây (Cloud Rendering) với nền tảng hệ thống được đầu tư bài bản và mạnh mẽ nhất với 20.000 Cores hỗ trợ song song sức mạnh điện toán của CPUs và GPUs.

iRender có đội ngũ nhân viên nhiệt tình luôn sẵn sàng hỗ trợ bạn 24/7. Bất cứ khi nào bạn gặp sự cố khi sử dụng máy chủ của chúng tôi hoặc thậm chí với phần mềm của bạn, chúng tôi – iRender Support Team luôn sẵn sàng trợ giúp bạn giải quyết vấn đề của mình. Chúng tôi cung cấp hỗ trợ chưa từng có phù hợp với nhu cầu và mục tiêu cụ thể của bạn.

Với tất cả những ưu điểm vượt trội kể trên, chắc hẳn bạn đã tìm được cho mình sự lựa chọn hoàn hảo cho iRender . Chúng tôi tin rằng chất lượng hỗ trợ mà chúng tôi cung cấp cũng quan trọng như công nghệ mà chúng tôi cung cấp. Chúng tôi cung cấp hỗ trợ chưa từng có phù hợp với nhu cầu và mục tiêu cụ thể của bạn. ƯU ĐÃI ĐẶC BIỆT cho tháng 10 này: Tặng 50% GIÁ TRỊ NẠP cho tất cả người dùng mới đăng ký. Hãy cùng kiểm tra nào!

iRender – Happy iRender!

Nguồn và ảnh: machinelearningmastery.com